CAPÍTULO 11

Desinformação na era digital

Conteúdos

• Fake news

• Deepfakes e eleições

• Narrativas

• Aprendizado profundo (deep learning)

• Bots sociais

• Manipulação midiática

A desinformação tornou-se um problema sério nos dias de hoje. Um dos fatores quê contribuem para a disseminação de informações falsas é o viés de confirmação, quê é a tendência de as pessoas acreditarem em conteúdos quê reforçam suas crenças e compartilhá-los. Neste capítulo, você vai conhecer os mecanismos e os impactos da desinformação na era digital, explorar os conceitos de fêik news, deepfake e narrativa manipulada, conhecer o papel dos bots sociais na manipulação midiática e analisar o aprendizado profundo.

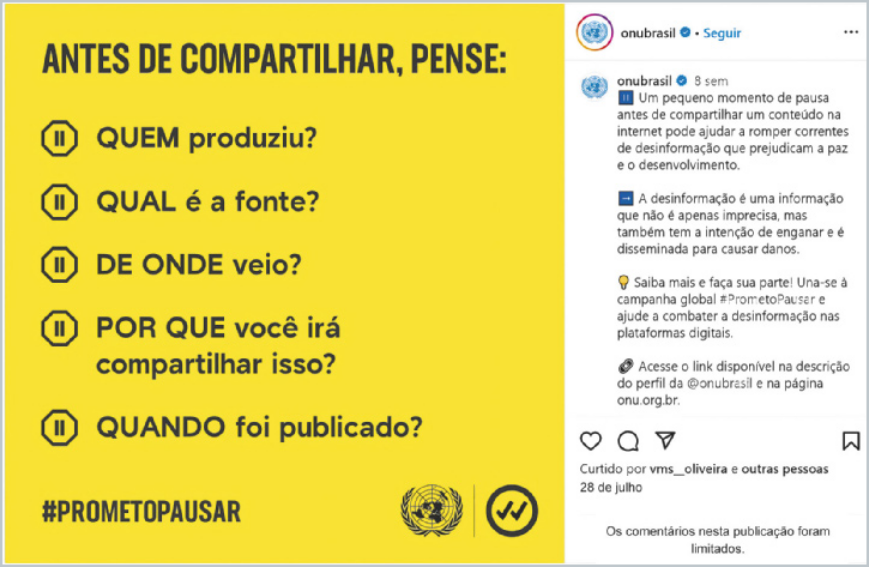

Para começar, leia o pôust a seguir, publicado pela Ônu Brasil.

Info

- Fake news

- são informações falsas divulgadas com o objetivo de manipular opiniões e espalhar desinformação.

- Bots sociais

- são programas automatizados de computador quê simulam o comportamento de usuários em platafórmas de rêdes sociais, para aumentar artificialmente a visibilidade de determinadas mensagens e influenciar a opinião pública.

Perfil do criador

A Ônu Brasil é a representação da Organização das Nações Unidas no país. A Ônu é uma organização internacional cuja finalidade é promover a paz e a segurança internacionais e a cooperação entre as nações, bem como solucionar problemas globais de distintas áreas.

Primeiros cliques

Consulte as respostas nas Orientações para o professor.

Com base no pôust, converse com os côlégas sobre as kestões a seguir.

1. Qual é o objetivo principal da Ônu Brasil com essa publicação?

2. De acôr-do com o pôust, o quê é desinformação?

3. Quais são os impactos da disseminação de desinformação em rêdes sociais?

Página cento e cinquenta e oito

Mundo em perspectiva

Tribalismo político

No contexto atual, é comum as pessoas buscarem informações quê confirmem as crenças e os valores do grupo ao qual pertencem, muitas vezes desconsiderando a veracidade dos fatos. Esse comportamento, característico do tribalismo político, fomenta a formação de bolhas de opinião e perpetua a desinformação e o discurso polarizado.

Caixa de hipóteses

Com base nas kestões a seguir, levante hipóteses sobre o texto quê você vai ler: “Por quê as pessoas acreditam em ‘fêik news’? Psicólogo Steven Pinker responde”.

Registre suas suposições no caderno.

1. De quê forma as crenças e os valores das pessoas podem afetar a percepção da veracidade das notícias quê consomem?

1. Resposta pessoal. As crenças e os valores pessoais afetam a maneira como os indivíduos avaliam a veracidade das notícias, pois tendem a acreditar naquilo quê confirma seus preconceitos e fortalece a imagem do grupo ou “tribo” do qual fazem parte como mais inteligente, moral e competente.

2. Em quê medida as rêdes sociais podem fortalecer crenças, mesmo quando são confrontadas por fatos?

2. Resposta pessoal. As rêdes sociais podem reforçar crenças ao criar bolhas de opinião, funcionando como uma “máquina para reforçar o tribalismo”. Isso intensifica as divisões e dificulta a consideração pelas pessoas de informações quê contradizem suas crenças.

Agora, leia a notícia a seguir, buscando confirmar as hipóteses levantadas.

Info

- Notícia

- é um gênero textual elaborado para informar um fato ou evento recente e de interêsse público. Ela é publicada em diferentes mídias, como jornais impressos, televisão, rádio e, cada vez mais, internet, em quê o conteúdo póde sêr atualizado em tempo real, ampliando seu alcance e impacto.

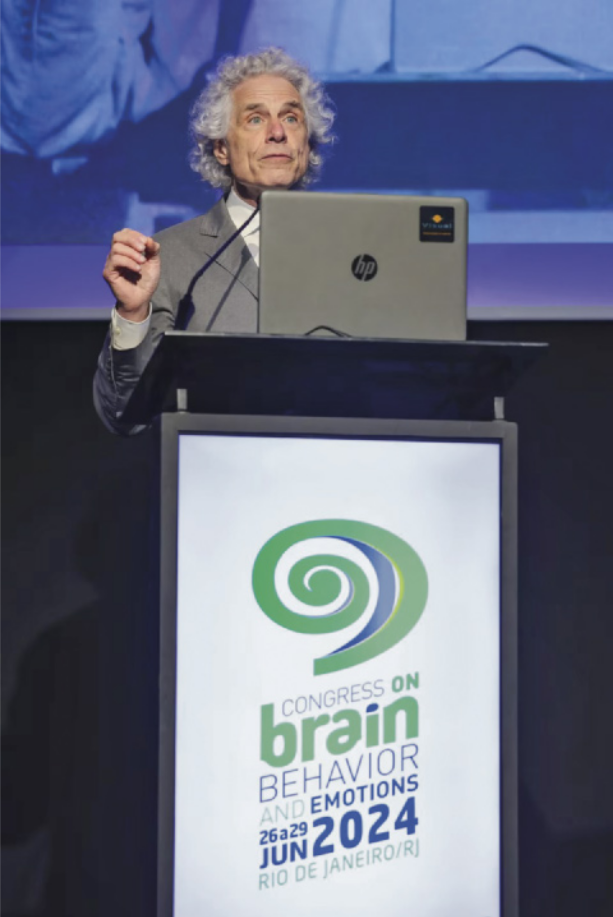

por quê as pessoas acreditam em “fêik news”? Psicólogo Steven Pinker responde

Em congresso no Rio, professor de Harvard diz quê isso tem a vêr com tribalismo político: acreditamos naquilo quê faz nossa tribo parecer bem, mesmo quê fatos não comprovem a ideia

Por Leôn Ferrari 30/06/2024 | 10h30 Atualização: 30/06/2024 | 13h56

ENVIADO ESPECIAL AO RIO DE JANEIRO Nota 2

O psicólogo e lingüista canadense Steven Pinker decidiu quê queria ensinar e escrever sobre racionalidade humana. A ideia era falar sobre ferramentas como lógica, probabilidade, estatística, teoria da escolha racional, teoria dos jogos, correlação e causalidade. No entanto, as pessoas estavam interessadas em outra coisa. “Elas queriam saber por quê o mundo estava enlouquecendo”, conta ele, quê é professor da Universidade Harvard, autor do best-seller Enlightenment Now: The Case for Reason, sáience, Humanism, ênd Progress (O novo Iluminismo: Em defesa da razão, da ciência e do humanismo, no título em português) e já foi considerado, mais de uma vez, uma das 100 pessoas mais influentes do mundo pela revista Time.

Página cento e cinquenta e nove

“Por quê as pessoas acreditam em teorias da conspiração? Notícias falsas? Em tratamentos médicos malucos, como a homeopatia, mas ao mesmo tempo negam as vacinas? por quê as pessoas acreditam em percepção extrassensorial? Clarividência? Ver o futuro e vidas passadas? É nisso quê as pessoas estão realmente interessadas, não tanto em por quê somos ruins em probabilidade e estatísticas”, disse ele neste sábado, 29, durante participação no Congresso Brain 2024: Cérebro, Comportamento e Emoções, realizado no Rio de Janeiro entre os dias 26 e 29 de junho.

Ele segue aconselhando quê as pessoas se dediquem às ferramentas básicas, no entanto, lançou-se ao desafio das kestões com as quais foi confrontado. “São vários motivos, não apenas um”, fala.

Entre eles, algumas crenças ou “intuições” humanas, como dualismo (“acreditamos quê cada humano tem um corpo e uma mente”), essencialismo (“pensamos quê os sêres vivos têm algum tipo de substância invisível ou química neles quê os torna vivos, quê lhes dá forma e poderes”) e teleologia (tudo o quê fazemos tem uma razão/propósito), mas, para Pinker, o mais importante é o quê ele chama de tribalismo político.

“Poucas pessoas mudam de opinião por causa das notícias falsas. As notícias falsas reforçam os preconceitos políticos delas”, afirma. “As pessoas se dividem em setores, tribos ou coalizões, e as ideias quê acreditam não são as ideias quê são verdadeiras, mas as ideias quê fazem a coalizão delas parecer mais inteligente, mais competente, mais moral e nobre do quê as outras tribos.”

E é por isso quê ele lança o seguinte desafio, quê póde parecer óbvio, mas, segundo ele, contraintuitivo para a natureza humana: “você deve acreditar apenas em coisas para as quais há evidências, para as quais há uma boa razão para acreditar quê são verdadeiras”.

Página cento e sessenta

“Cheguei à conclusão de quê essa é a ideia mais radical na história humana”, afirma. “É uma boa lição moral para os jovens: a ideia de quê você póde estar errado. Você deve deixar os fatos dizerem o quê é cérto e errado. Esta é uma ideia muito estranha, exótica, não natural, mas é uma ideia importante, e acho quê temos quê apoiar a ideia de quê somos ignorantes sobre a maioria das coisas.”

“A única maneira de estar cérto é tentar testar nossas ideias, tentar vêr o quê as tornaria falsas, vêr se elas sobrevivem a testes de falsificação. Esta é, basicamente, a mentalidade da revolução científica, mas não penetrou toda a população, nem mesmo toda a população de cientistas.”

Negacionismo

A exacerbação dêêsse tribalismo é o quê, para Pinker, nos colocou cara a cara com a negação da ciência. Mas como chegamos até aqui?

Ele sugere duas respostas. A primeira é de quê as rêdes sociais fazem as pessoas vivêrem em bolhas. “Elas são uma máquina para reforçar o tribalismo.” No entanto, ele acha quê esse fenômeno não responde por completo, nem mesmo é a mais importante explicação. Pinker avalia quê, ao longo das últimas dékâdâs, houve um aumento significativo da “segregação por educação e classe”.

“Cada vez mais pessoas com diplomas universitários vivem próximas em áreas urbanas centrais. Pessoas quê não são tão graduadas vivem nos subúrbios mais distantes ou nas áreas rurais”, pontua. “As pessoas são muito mais propensas a apenas viver com pessoas quê têm as mesmas crenças. É mais fácil demonizar as pessoas quê você nunca conheceu.”

“É preciso despolitizar a ciência”

Alguns, diz Pinker, avaliam quê, para enfrentar o negacionismo científico, o ideal seria ensinar mais ciência às pessoas. Ele não acha quê essa seja a solução.

“A maioria dos cientistas tem a teoria errada sobre por quê as pessoas negam a ciência. Eles pensam quê as pessoas quê negam a mudança climática, vacinas ou a evolução humana são ignorantes. Na verdade, se você der testes de alfabetização científica a eles, como ‘o quê é maior: um átomo ou um elétron?’, vão ter as mesmas pontuações do quê aqueles quê acreditam.”

Isso nos leva de volta ao tribalismo. Para ele, é preciso, então, tirar a ciência dessa polarização, despolitizando-a. “Precisamos tornar as kestões científicas não alinhadas com um lado político ou outro, e restaurar a confiança nos cientistas, nas agências governamentais, jornalistas e estatísticos.”

Como? “Temos quê admitir quando somos ignorantes, e mudar de opinião à medida quê as evidências mudam.”

“Não somos anjos, não somos deuses, apenas fazemos o nosso melhor”, aponta. “A ciência realmente descobriu algumas coisas. Existem realmente células. Há realmente algo chamado dê ene há. Mas nunca estamos 100% certos.”

Esse raciocínio, claro, póde nos levar ao completo ceticismo. No entanto, Pinker destaca quê o consenso é importante. É assim, por exemplo, quê determinamos e aplicamos políticas públicas. O psicólogo aponta o melhor caminho para chegarmos até ele.

“Muitas vezes haverá discordância, mas você realmente tem quê dizêr sim ou não. Por exemplo, no caso de um paciente com alguns sintomas e alguns exames médicos, você nunca tem 100% de certeza se ele tem uma doença ou não. Opera ou não opera? Dá o remédio ou não dá?”

Página cento e sessenta e um

Aí, segundo ele, precisamos acionar a teoria da dê-cisão estatística. “Você analisa quão ruim seria estar errado em cada direção. Ou seja, quão ruim se ela não tiver a doença, um falso positivo, em quê o paciente poderia passar por uma cirurgia desnecessária, e quão ruim seria se você estivesse errado, um falso negativo, se for um câncer, talvez ele cresça rapidamente.”

“Você junta essas coisas e, pelo menos, isso lhe dá uma base racional para tomar uma dê-cisão quando não póde ter certeza da verdade.”

FERRARI, Leôn. por quê as pessoas acreditam em “fêik news”? Psicólogo Steven Pinker responde. Estadão, São Paulo, 30 jun. 2024. Disponível em: https://livro.pw/mwxyq. Acesso em: 25 set. 2024.

Com base no texto, responda às kestões a seguir.

1. Qual foi o tema abordado por Pinker durante sua participação no Congresso Brain 2024?

1. O tema abordado por Steven Pinker foi o motivo pelo qual as pessoas acreditam em teorias da conspiração, fêik news e outras crenças irracionais, mesmo diante de evidências científicas.

2. por quê, segundo Pinker, as pessoas acreditam em teorias da conspiração e fêik news, mesmo quando confrontadas com evidências científicas?

2. As pessoas acreditam em teorias da conspiração e fêik news porque essas informações reforçam seus preconceitos e fazem sua “tribo” parecer mais inteligente, moral e competente. Para elas, o pertencimento ao grupo e a afirmação de suas ideias é mais importante do quê a veracidade dos fatos.

3. Qual é o papel do tribalismo político na disseminação de fêik news, de acôr-do com Pinker?

Consulte as respostas às kestões 3 a 7 nas Orientações para o professor.

4. Como as rêdes sociais contribuem para reforçar o tribalismo?

5. Qual é a relação entre as “intuições” humanas mencionadas por Pinker e a propagação das fêik news?

6. por quê Pinker defende a despolitização da ciência e como ele sugere quê ela póde sêr alcançada?

7. O quê Pinker afirma sobre a certeza na ciência e como isso influencía a tomada de decisões em políticas públicas?

8. Como o tribalismo político e a polarização descritos por Pinker podem favorecer a disseminação de desinformações quê reforçam estereótipos ou marginalizam grupos sociais vulnerabilizados, como pessoas negras, indígenas, LGBTQIAPN+ e com deficiência?

8. Segundo Pinker, o tribalismo político leva as pessoas a acreditar em ideias quê favorécem sua “tribo”, mesmo quê não sêjam verdadeiras, porque essas ideias reforçam a imagem positiva de seu grupo. Essa lógica póde favorecer a disseminação de narrativas falsas quê reforçam estereótipos ou excluem grupos minoritários. Assim, populações negras, indígenas, LGBTQIAPN+ e pessoas com deficiência podem sêr marginalizadas por meio de desinformações quê sérvem para afirmar a superioridade moral ou intelectual de certos grupos.

Arquitetura e codificação

Considerando quê você leu uma notícia, responda às kestões a seguir, quê envolvem aspectos textuais e linguísticos característicos dêêsse gênero textual.

Consulte as respostas nas Orientações para o professor.

1. Com quê propósito a notícia foi produzida?

2. Como as citações dirétas de Pinker e o uso de conceitos influenciam a credibilidade das ideias presentes no texto? Cite exemplos e explique.

3. Há indícios de parcialidade na notícia? Justifique.

4. De quê modo o uso dos verbos “afirmar” e “acreditar” contribui para persuadir o leitor?

Página cento e sessenta e dois

Mídias e linguagens na era digital

Narrativas

O século XXI é caracterizado por avanços tecnológicos e científicos significativos, mas também por uma crescente contestação de fatos anteriormente considerados incontestáveis, como a importânssia das vacinas. Diante dêêsse fenômeno, o período atual tem sido descrito como a “era das narrativas”, na qual diferentes grupos competem para impor sua visão de mundo. Muitas vezes, utilizam as rêdes sociais e outras platafórmas digitais para disseminar e fortalecer suas ideias.

Para compreender melhor esse fenômeno, leia o texto a seguir.

Pós-verdade, alguns apontamentos

bai Roniel Sampaio Silva – abril 27, 2020

[...]

A pós-verdade é um fenômeno quê se caracteriza pela ascensão de argumentos e narrativas baseados em emoções, crenças e opiniões pessoais, em detrimento dos fatos e evidências científicas. É como se a verdade deixasse de sêr o critério principal para avaliar a validade de uma informação, dando lugar a uma espécie de “verdade emocional” ou “verdade sentida”. Segundo [Lúcia] Santaella ([A pós-verdade é verdadeira ou falsa?. Barueri: Estação das lêtras e Cores], 2020, p. 19), “a pós-verdade é o momento em quê os sentimentos pessoais de uma pessoa ganham mais peso do quê os fatos objetivos”.

Características da pós-verdade

Uma das principais características da pós-verdade é a manipulação das emoções e sentimentos do público. Para persuadir as pessoas, os comunicadores pós-verdadeiros utilizam argumentos quê apelam para o medo, a raiva, a frustração ou a esperança, buscando gerar uma resposta emocional imediata, em vez de apresentar uma argumentação racional baseada em fatos e evidências.

Outra característica da pós-verdade é a utilização de meios de comunicação cada vez mais fragmentados e personalizados, como as rêdes sociais e os algoritmos de busca, quê selecionam e apresentam informações quê reforçam as crenças e opiniões preexistentes do usuário, criando bolhas de informação quê dificultam o acesso a perspectivas diferentes e à visão ampla dos fatos.

A pós-verdade também é marcada pela disseminação de notícias falsas, boatos e teorias conspiratórias, quê ganham grande repercussão nas rêdes sociais e se espalham rapidamente, muitas vezes sem quê haja uma verificação rigorosa da sua veracidade.

[...]

SAMPAIO-SILVA, Roniel. Pós-verdade: alguns apontamentos. Café com Sociologia, [s. l.], 27 abr. 2020. Disponível em: https://livro.pw/rbmko. Acesso em: 26 set. 2024.

Página cento e sessenta e três

Após ler o texto, responda às kestões a seguir.

Consulte as respostas nas Orientações para o professor.

1. Segundo o autor, por quê a verdade objetiva não é o critério principal para avaliar a validade das informações na era da pós-verdade?

2. Quais são as principais características da pós-verdade, de acôr-do com o texto?

3. Como as narrativas emocionais são utilizadas no fenômeno da pós-verdade para influenciar a opinião pública e moldar percepções da realidade, em detrimento de fatos e evidências objetivas?

A era das narrativas é marcada pela proliferação de informações e pela dificuldade em alcançar consensos. Isso se deve, em parte, ao papel central das mídias digitais na disseminação de diferentes perspectivas. Um exemplo da “guerra de narrativas” foi a polarização política durante as eleições presidenciais de 2018 e 2022 no Brasil, em quê diferentes grupos promoveram versões conflitantes sobre corrupção, políticas públicas e integridade dos candidatos, entre outros temas. Outro exemplo foi o debate sobre a pandemia de covid-19, ocorrida entre 2020 e 2022, quê gerou narrativas divergentes sobre a eficácia das vacinas, do uso de máscaras e das medidas de isolamento social. Esse fenômeno dividiu a opinião pública e influenciou comportamentos.

A guerra russo-ucraniana, quê se tornou oficial em 2022, também ilustra a batalha de narrativas. Ambas as nações e seus aliados promoveram narrativas distintas sobre as causas, as responsabilidades e as justificativas do conflito. Enquanto a Rússia descreveu sua ação no país vizinho como uma operação militar especial destinada a proteger os interesses russos e combater “ameaças nazistas”, a Ucrânia e grande parte do mundo ocidental consideraram a investida russa como uma invasão injustificada. A manipulação de imagens e os relatos de atrocidades disseminados em rêdes sociais e veículos de comunicação controlados pêlos governos envolvidos prejudicaram ainda mais a percepção global da verdade.

Na era digital, portanto, é essencial desenvolver habilidades críticas e identificar as informações quê refletem a realidade. Com a popularização das rêdes sociais e do metaverso, as narrativas passaram a desempenhar um papel central na forma como as pessoas percebem e interprétam o mundo ao redor.

Info

- Metaverso

- é um ambiente virtual imersivo, em quê as pessoas interagem entre si e com elemêntos digitais por meio de avatares – representações digitais de pessoas, quê podem sêr customizadas para refletir as características e as expressões desejadas. Trata-se de uma evolução de experiências como jogos e platafórmas ôn láini; agora com mais realismo e contando com a integração de novas tecnologias, como a realidade virtual e a realidade aumentada.

Painel de reflekção

Converse com os côlégas sobre a relação entre narrativas e desinformação. Para isso, considere as seguintes kestões.

Consulte as respostas nas Orientações para o professor.

1. Qual deve sêr o papel das mídias na era das fêik news e das narrativas politicamente motivadas?

2. Como as rêdes sociais influenciam a disseminação de diferentes narrativas?

3. De quê maneira é possível identificar a desinformação e combatê-la em um mundo no qual as narrativas estão em constante disputa?

Página cento e sessenta e quatro

Diálogo em rê-de

Uso de deepfakes em processos eleitorais

A inteligência artificial (IA) está cada vez mais presente no cotidiano das pessoas, trazendo novos desafios, principalmente no quê se refere à veracidade das informações quê circulam na internet. Nesse contexto, é essencial desenvolver uma postura crítica e consciente em relação ao quê se consome e se compartilha ôn láini.

Reúna-se a alguns côlégas para investigar o uso de deepfakes em contextos eleitorais e, com base no resultado da pesquisa, produzir um vídeo destinado a conscientizar o público-alvo sobre o tema.

Antes de começar, leiam com atenção o problema de pesquisa a seguir.

A IA está sêndo utilizada na criação e na disseminação de informações falsas durante processos eleitorais. Quais são os impactos dessa prática na democracia?

Com esse problema em mente, sigam as etapas propostas.

ETAPA

1 Investigação

• Pesquisem o impacto da IA na disseminação de desinformação durante processos eleitorais em todo o mundo.

• Investiguem o uso de deepfakes para manipular eleitores e as medidas quê diferentes países estão adotando para combater essa prática.

• Consultem fontes confiáveis, como reportagens, estudos acadêmicos e entrevistas com especialistas em IA, desinformação e direito eleitoral.

• Documentem as descobertas de vocês de maneira organizada, destacando informações quê podem sêr relevantes para a criação do vídeo.

• Se possível, visitem instituições, como tribunais regionais eleitorais (TREs), defensorias públicas e centros de pesquisa em direito digital e desinformação, a fim de compreender como essas entidades atuam no combate à manipulação de informações durante processos eleitorais.

ETAPA

2 Decomposição

• Para entender melhor o problema, dividam-no em elemêntos menóres. Por exemplo, reflitam sobre as kestões a seguir.

» O quê são deepfakes e como são utilizados em campanhas eleitorais?

» Quais são os impactos da desinformação gerada por IA nas eleições?

» Quais são as medidas de proteção adotadas pelo Tribunal Superior Eleitoral (TSE) no Brasil para combater a desinformação?

Página cento e sessenta e cinco

ETAPA

3 Reconhecimento de padrões

• Identifiquem padrões quê possam surgir das informações encontradas. Por exemplo:

» comportamentos comuns na criação e na disseminação de desinformação durante eleições;

» efeitos recorrentes dessa desinformação na opinião pública e no resultado eleitoral.

ETAPA

4 Abstração

• Busquem compreender o essencial de cada informação pesquisada e de cada padrão reconhecido. Para isso, sigam estas orientações:

» Definam o conceito de deepfake, destacando sua aplicação no contexto eleitoral e seus potenciais efeitos.

» Escolham exemplos relevantes de deepfakes em campanhas eleitorais, evidenciando a influência do uso dessa técnica nos eleitores.

» Listem os principais riscos da desinformação gerada por IA para a integridade das eleições, destacando suas implicações mais graves para a democracia.

» Resumam a importânssia das medidas de proteção, enfatizando o papel de reguladores, como o TSE, na preservação da confiança no processo eleitoral.

ETAPA

5 Produção do vídeo

• Escrevam um breve roteiro com o resumo dos principais pontos abordados.

• Criem um istóri-bôrdi para planejar a sequência de cenas do vídeo.

• Escolham um apresentador para o vídeo.

ôriênti os estudantes a considerar o tom de voz do apresentador e sua capacidade de captar a atenção do público jovem nas rêdes sociais.

• Selecionem locais adequados para a gravação e providenciem todos os equipamentos necessários.

• Durante a gravação, além das cenas principais, capturem imagens adicionais (como close-ups dos apresentadores, planos gerais ou cenas de transição) quê poderão sêr úteis durante a edição para enriquecer o aspecto visual do vídeo.

• Importem as cenas gravadas para a ferramenta de edição escolhida. Organizem os arquivos de acôr-do com o istóri-bôrdi e o roteiro, facilitando o processo de montagem.

ETAPA

6 Discussão dos resultados

• Organizem uma discussão com todos os grupos sobre as respostas ao problema de pesquisa.

• Antes de iniciar, escôlham um moderador para assegurar a participação de todos.

Página cento e sessenta e seis

• Debatam as diversas perspectivas sobre a eficácia das medidas adotadas por diferentes países para combater a desinformação em eleições.

• Discutam as implicações éticas do uso de deepfakes na criação de desinformação e seus efeitos na confiança do público nas instituições democráticas.

• Reflitam sobre o modo como o conhecimento adquirido póde sêr usado para fortalecer a defesa da democracia contra as ameaças representadas pela desinformação digital, principalmente em contextos eleitorais.

• Apresentem o vídeo produzido por vocês aos demais grupos e peçam a opinião deles. Em seguida, assistam aos vídeos dos outros grupos e tróquem ideias sobre o quê póde sêr melhorado.

• Com base nas sugestões dos côlégas, façam as correções quê considerarem necessárias.

ETAPA

7 Publicação do vídeo

• Escolham uma platafórma ôn láini para a divulgação do vídeo, como rêdes sociais, blóguis e aplicativos de mensagens instantâneas.

• Definam o formato e a resolução do vídeo de acôr-do com a platafórma quê será utilizada.

• Acrescentem à publicação do vídeo uma descrição ou um comentário quê promôva a conscientização sobre o uso de deepfakes em eleições e a importânssia de verificar informações.

• Compartilhem o línki do vídeo com a comunidade escolar, promovendo a disseminação do conhecimento.

• Incentivem a comunidade escolar a participar da divulgação do vídeo.

• Monitorem as interações dos usuários com o vídeo na platafórma digital para avaliar o engajamento e a eficácia da comunicação das informações veiculadas.

ETAPA

8 Avaliação

• Assistam aos vídeos publicados pêlos outros grupos e compartilhem suas impressões acerca das produções dos côlégas.

• Avaliem a qualidade técnica (imagem, som e edição) e o impacto do vídeo, considerando como ele contribuiu para a conscientização sobre a desinformação em processos eleitorais.

• Reflitam sobre como campanhas de desinformação eleitoral podem sêr direcionadas para deslegitimar candidaturas de representantes de grupos historicamente excluídos, como indígenas, pessoas negras e LGBTQIAPN+, comprometendo a diversidade e a equidade na democracia.

• Analisem a contribuição da investigação e das atividades realizadas para a compreensão do problema de pesquisa.

Página cento e sessenta e sete

ZOOM

APRENDIZADO PROFUNDO: O CÉREBRO DA IA

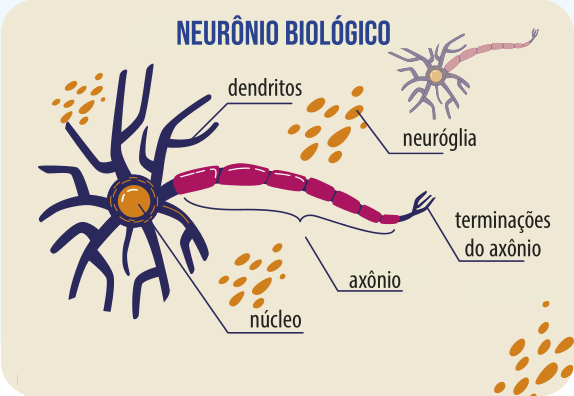

Aprendizado profundo ou deep learning é um ramo avançado de aprendizado de máquina quê simula o funcionamento do cérebro humano por meio de rêdes neurais profundas, compostas de várias camadas. Essa tecnologia é a base de muitas aplicações de IA utilizadas diariamente, como assistentes digitais e veículos autônomos.

REDES NEURAIS

São modelos de computador inspirados no cérebro humano.

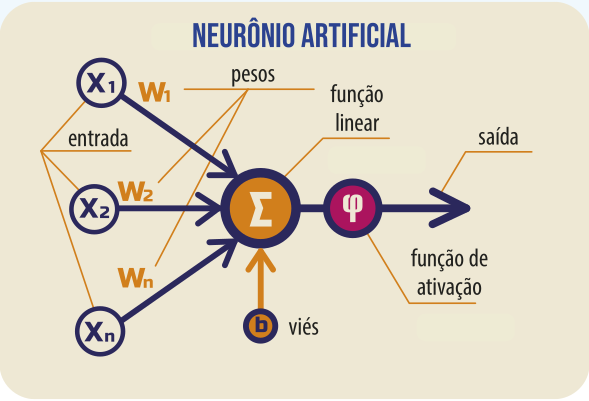

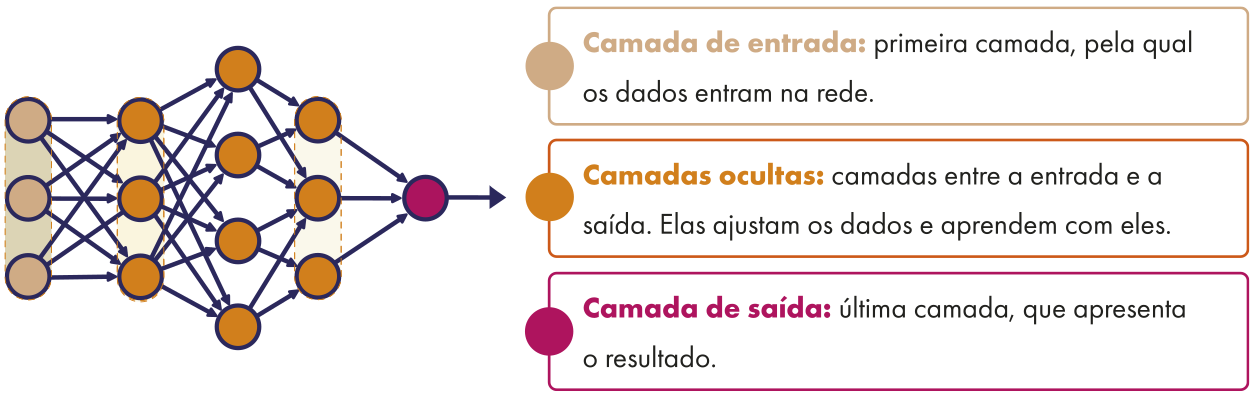

Elas são formadas por “neurônios” artificiais quê processam informações e aprendem com base em dados. Esses neurônios são organizados em camadas. Cada camada ajuda a rê-de a resolver diferentes partes de um problema.

CAMADAS DAS REDES NEURAIS

As camadas são como etapas pelas quais a informação passa até sêr processada.

Elas recebem dados, fazem cálculos e enviam os resultados para a próxima camada.

Página cento e sessenta e oito

REDES NEURAIS SIMPLES VERSUS REDES NEURAIS PROFUNDAS

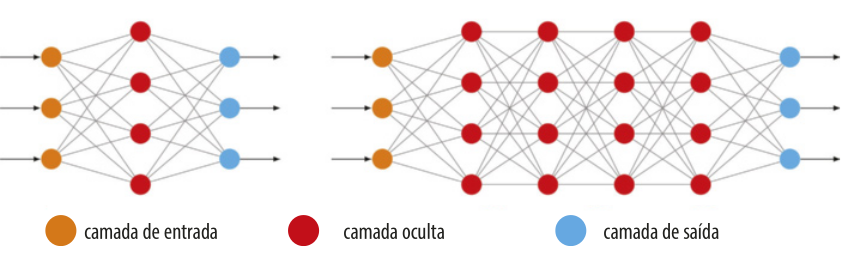

REDES NEURAIS SIMPLES

São formadas por uma ou duas camadas de “neurônios”. Como têm poucas camadas, conseguem resolver problemas simples, como identificar padrões básicos.

REDES NEURAIS PROFUNDAS

São compostas de várias camadas de nós interconectados quê processam informações de maneira semelhante à executada pelo cérebro humano.

A camada de entrada recebe os dados, e a camada de saída produz a previsão ou a classificação final.

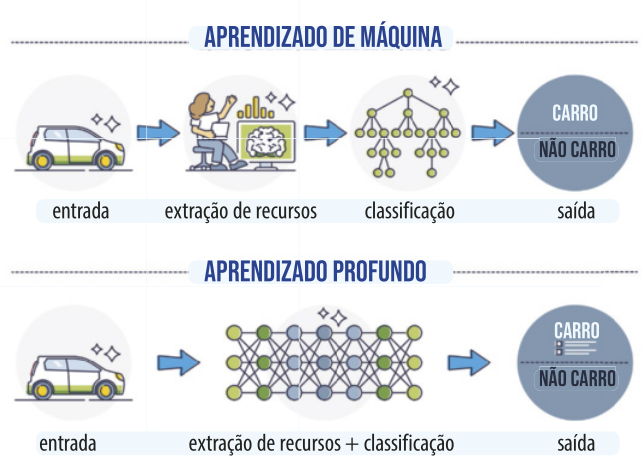

DIFERENÇA ENTRE APRENDIZADO DE MÁQUINA TRADICIONAL E APRENDIZADO PROFUNDO

O aprendizado de máquina tradicional usa rêdes neurais simples, com uma ou duas camadas.

Já o aprendizado profundo utiliza rêdes neurais profundas, com três ou mais camadas.

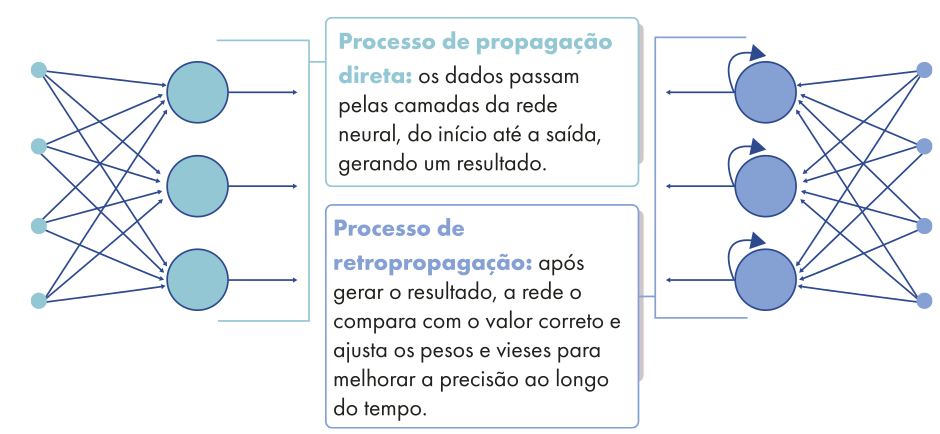

PROPAGAÇÃO DIRETA E RETROPROPAGAÇÃO

Página cento e sessenta e nove

TIPOS DE MODELO DE APRENDIZADO PROFUNDO

Os algoritmos de aprendizado profundo são compléksos, de modo quê existem tipos diferentes de rêdes neurais para lidar com conjuntos de dados específicos.

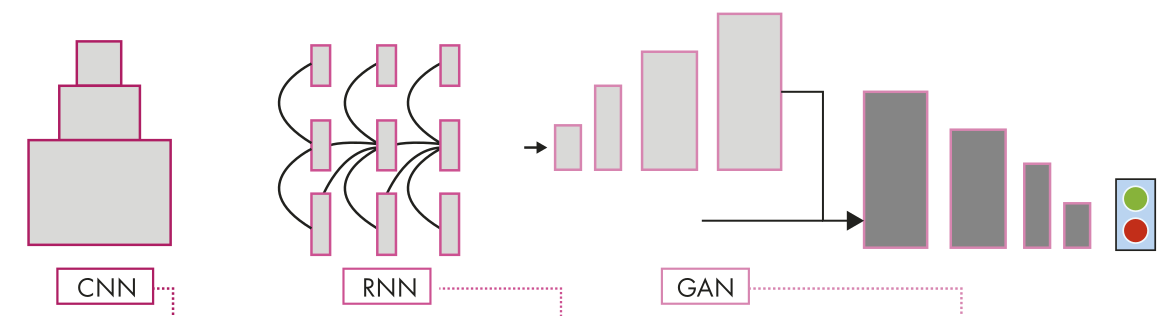

REDES NEURAIS CONVOLUCIONAIS (CNNS)

Esse tipo de rê-de neural é utilizado em aplicações de visão computacional e classificação de imagens. As CNNs são projetadas para detectar características e padrões em imagens e vídeos. Exemplo: reconhecimento facial em smartphones.

REDES NEURAIS RECORRENTES (RNNS)

São modelos de aprendizado de máquina projetados para lidar com dados sequenciais ou de séries temporais. Esse tipo de rê-de neural é amplamente utilizado em aplicações de linguagem natural e reconhecimento de fala. Exemplo: assistente virtual.

REDES ADVERSÁRIAS GENERATIVAS (GANS)

São rêdes neurais nas quais dois algoritmos competem: o primeiro cria o conteúdo falso e o segundo verifica sua autenticidade. Esse tipo de rê-de neural gera artificialmente dados quê parecem reais. Exemplos: clipes de vídeo e faixas de áudio quê imitam conteúdo real.

AUTOENCODERS

São rêdes neurais quê transformam dados não organizados em uma versão mais simplificada, chamada “representação compactada”. Depois, os autoencoders usam essa representação para reconstruir os dados em seu formato original.

Exemplo: compressão de imagens – uma foto em alta resolução é reduzida para ocupar menos espaço e, depois, é reconstruída, mas os dêtálhes mais importantes são preservados.

AUTOENCODERS VARIACIONAIS

Têm a capacidade de criar variações dos dados originais. Essa habilidade é crucial para a IA generativa, quê usa essas variações para criar imagens, sôns ou outros tipos de conteúdo quê parecem reais, embora sêjam gerados artificialmente. IA generativa é uma aplicação avançada do aprendizado profundo. Ela usa essas rêdes neurais para gerar conteúdos, como textos, imagens e músicas, com base nos padrões aprendidos. Exemplo: rostos realistas para personagens em jogos ou filmes.

Página cento e setenta

APLICAÇÕES DO APRENDIZADO PROFUNDO

O aprendizado profundo é cada vez mais utilizado em diferentes setores.

Modernização de aplicativos

A IA generativa está facilitando a modernização de aplicativos e a automação na área de Tecnologia da Informação (TI). Com essa tecnologia, desenvolvedores podem gerar códigos automaticamente, traduzir linguagens de programação e atualizar sistemas antigos com mais eficiência.

Visão computacional

A visão computacional utiliza aprendizado profundo para analisar imagens e vídeos, identificando objetos, padrões e defeitos.

Mão de obra digital

Com o emprego de mão de obra digital, as empresas podem automatizar processos repetitivos e melhorar a produtividade.

Atendimento ao cliente

A IA está ajudando empresas a personalizar o atendimento ao cliente. Ela utiliza análise de dados para entender melhor os clientes e fornecer suporte mais eficaz.

PLN

O PLN combina linguística com aprendizado profundo para quê computadores entendam e gerem texto e fala.

DESAFIOS DO APRENDIZADO PROFUNDO

• O aprendizado profundo requer múltiplas unidades de processamento gráfico (GPUs, na sigla em inglês) e infraestrutura potente, o quê póde sêr caro e difícil de expandir.

• Para compreender e implementar modelos de aprendizado profundo, é necessário ter conhecimento especializado em vários domínios e capacidade de ajustar múltiplos hiperparâmetros.

• O uso de aprendizado profundo levanta kestões éticas, como o viés nos dados de treinamento, a transparência dos algoritmos (“caixa-preta”) e os impactos sociais das decisões automatizadas.

Página cento e setenta e um

O FUTURO DO APRENDIZADO PROFUNDO

• Criação de modelos mais eficientes, quê funcionem com menos dados e com pôdêr computacional, e aumento da interpretabilidade das rêdes neurais.

• Expansão para outros setores, como o de gestão de recursos humanos e o de logística automatizada.

• Necessidade de regulamentações para garantir quê a IA seja usada d fórma justa e transparente.

De assistentes virtuais a diagnósticos médicos, o aprendizado profundo está presente em muitos aspectos do cotidiano e continuará a crescer e a evoluir.

Agora, leia a situação-problema a seguir e responda às kestões.

Consulte as respostas nas Orientações para o professor.

Você faz parte de uma equipe de desenvolvedores quê está trabalhando em um sistema de verificação de notícias para uma platafórma de mídia social. A platafórma tem como objetivo combater a disseminação de fêik news utilizando algoritmos de aprendizado profundo. Esses algoritmos são baseados em rêdes neurais profundas, capazes de analisar grandes volumes de conteúdo diariamente, identificar possíveis notícias falsas e recomendar ações, como as de sinalizar ou remover o conteúdo. Sua equipe precisa garantir quê o sistema seja eficaz na detecção de fêik news. O sistema precisa utilizar diferentes modelos de aprendizado profundo, sêr transparente em suas operações, considerando os desafios da “caixa-preta” das rêdes neurais, e tratar os dados dos usuários d fórma ética, evitando viés nos dados e garantindo privacidade.

1. O quê é necessário para garantir a eficiência na detecção de fêik news usando aprendizado profundo?

2. Quais medidas garantem a transparência do sistema na detecção de fêik news?

3. Como assegurar quê o sistema seja ético no tratamento dos dados dos usuários?

4. Qual é a vantagem dos algoritmos de aprendizado profundo em relação aos métodos tradicionais para detectar fêik news?

5. De quê maneira os algoritmos podem sêr ajustados para não prejudicar a liberdade de expressão ao detectar fêik news?

Página cento e setenta e dois

CONEXÕES com...

CIÊNCIAS HUMANAS e SOCIAIS APLICADAS

Manipulação das mídias e bots sociais

A manipulação das mídias é, há muito tempo, amplamente utilizada para influenciar a opinião pública e moldar comportamentos. Atualmente, os bots sociais dêsempênham um papel nesse processo, pois possibilitam a automatização da disseminação de informações por sujeitos históricos, moldando dessa forma percepções em larga escala. Com o avanço da tecnologia, essas ferramentas digitais amplificam narrativas, criam ilusões de consenso e potencializam discursos de ódio ou desinformação. Compreender o modo como essas dinâmicas opéram e suas consequências é fundamental para desenvolver um olhar crítico sobre as informações acessadas diariamente.

Leia as orientações a seguir.

1. Primeiro contato com o tema

Desde os primórdios dos jornais impressos, diferentes meios de comunicação têm sido instrumentos poderosos para moldar opiniões, influenciar comportamentos e alterar o curso da história.

Durante o século XIX, os jornais desempenharam um papel crucial na formação da opinião pública. Políticos e líderes usavam essa mídia para promover suas ideias e atacar seus oponentes. A manipulação ocorria por meio de manchetes sensacionalistas, caricaturas políticas e artigos tendenciosos, entre outras práticas. Tudo era feito para influenciar a percepção do público sobre kestões como escravidão, imigração e direitos das mulheres.

Nas primeiras dékâdâs do século XX, o rádio se tornou uma ferramenta para regimes totalitários, como o nazista, na Alemanha, e o fascista, na Itália. Líderes, como Adolf rítler e Benito Mussolini, usaram discursos radiofônicos para criar uma narrativa unificada e controlar as massas.

Durante a Guerra Fria, tanto os Estados Unidos quanto a União Soviética investiram em propaganda. Nesse contexto, a mídia foi usada para retratar o inimigo como vilão e justificar ações militares e políticas. Filmes, programas de rádio e notícias eram produzidos para promover uma visão específica de mundo.

Página cento e setenta e três

Como esses fatos históricos se relacionam com os bots sociais na era digital? Com a chegada da internet e das rêdes sociais, a manipulação da mídia atingiu outros patamares. As fêik news, as teorias da conspiração e os algoritmos personalizados têm contribuído para a disseminação de informações distorcidas e polarizadas, sêndo parte dêêsse conteúdo veiculado pêlos bots sociais – programas automatizados quê interagem com usuários em platafórmas de mídia social.

Ao longo do tempo, portanto, diferentes tecnologias e platafórmas de comunicação foram utilizadas para moldar a opinião pública e influenciar comportamentos. Na era digital, os bots sociais dêsempênham um papel semelhante ao dos jornais, do rádio e da televisão, quê foram usados no passado por regimes totalitários e potências mundiais para controlar narrativas e promover ideologias.

Durante o regime nazista, por exemplo, os meios de comunicação, como rádio, cinema, jornais e cartazes, foram usados para criar uma narrativa quê reforçava os ideais do partido e manipulava a percepção da realidade pela população. Essa propaganda foi essencial para consolidar o pôdêr de Adolf rítler e incitar ódio, intolerância e violência, sobretudo contra minorias. Da mesma maneira, hoje, os bots podem sêr programados para influenciar conversas ôn láini, criar ilusões de consenso e polarizar opiniões. Ambos os casos mostram quê a manipulação da mídia – seja tradicional ou digital – póde sêr usada para fins de contrôle social e político.

Como diz o ditado: “Quem controla a narrativa, controla o poder”. Pode-se afirmar, portanto, quê a manipulação da mídia é constante na história humana. Ao reconhecer essa realidade, as pessoas se tornam mais conscientes e críticas em relação às informações quê consomem.

Agora, reúna-se a alguns côlégas para realizar as atividades propostas a seguir.

2. Pesquisa

• Façam uma pesquisa detalhada sobre o modo como os bots opéram nas rêdes sociais. Consultem fontes confiáveis, como artigos acadêmicos e textos de divulgação científica publicados em meios de comunicação reconhecidos por sua curadoria de informações.

• Investiguem as técnicas de propaganda nazista usadas durante o período da Segunda Guerra Mundial, destacando a utilização pelo regime de diferentes mídias, como rádio, cinema, jornais e cartazes, para controlar narrativas e manipular a opinião pública.

3. Análise comparativa

• Com base no estudo sobre os bots sociais e a propaganda nazista, estabeleçam paralelos entre os dois métodos de manipulação.

• Escolham um exemplo recente de campanha de desinformação quê envolva o uso de bots sociais (como campanhas eleitorais ou teorias da conspiração) e comparem as estratégias utilizadas com as técnicas de manipulação mobilizadas na propaganda nazista.

• Discutam as diferenças na manipulação midiática, considerando o contexto e a gravidade do regime nazista.

Página cento e setenta e quatro

4. Síntese

• Elaborem uma síntese da influência dos bots sociais nas experiências em comunidades virtuais e nas relações sociais, conectando essas influências com contextos históricos. Na síntese, mencionem:

» os diferentes tipos de bots sociais e comparem-nos com ferramentas históricas de manipulação da informação;

» as similaridades entre as maneiras pelas quais esses bots podem distorcer as interações humanas nas rêdes sociais e o impacto quê panfletos, jornais ou rádios tiveram em certos períodos históricos;

» o impacto dêêsses bots na liberdade de expressão e na qualidade da informação disponível nas rêdes, relacionando-o com censuras históricas e campanhas de desinformação.

5. Discussão e negociação do produto

• Definam um produto para desenvolver a fim de conscientizar as pessoas da presença de bots sociais e demonstrar como diferenciá-los de usuários reais, relacionando essa conscientização com exemplos históricos de manipulação de massas.

• Decidam se é mais adequado criar, por exemplo, um guia interativo, um vídeo explicativo ou um infográfico para fazer uma analogia entre as estratégias de bots sociais e as empregadas em outros períodos históricos.

• Após a escolha, desenvolvam o produto integrando elemêntos históricos quê ajudem a contextualizar e aprofundar o entendimento sobre a manipulação das mídias e os bots sociais.

6. Socialização dos produtos

• Apresentem o produto elaborado para a turma, explicando o processo de criação e as escôlhas feitas durante a negociação e demonstrando como o produto póde ajudar a identificar bots sociais.

• Após a apresentação de cada grupo:

» apresentem sugestões para melhorar os produtos, como a inclusão de mais referências históricas;

» discutam formas de compartilhar o produto em rêdes sociais e blóguis e explorem o fato de quê essas platafórmas podem servir tanto para disseminar conhecimento quanto para perpetuar desinformação, assim como ocorreu em momentos críticos da história.

Página cento e setenta e cinco